TPU (Tensor Processing Unit) гэдэг нь Google компаниас тусгайлан машин сургалтын даалгавруудыг хурдасгах зорилгоор бүтээсэн ASIC (Application specific integrated circuit) юм. Анх 2015 онд танилцуулагдсан бөгөөд гүн сургалтын ажлуудад CPU болон GPU – аас илүү өндөр гүйцэтгэл, бага энерги хэрэглээ, хямд өртөг бүхий шийдэл юм

Яагаад TPU хэрэгтэй болсон бэ?

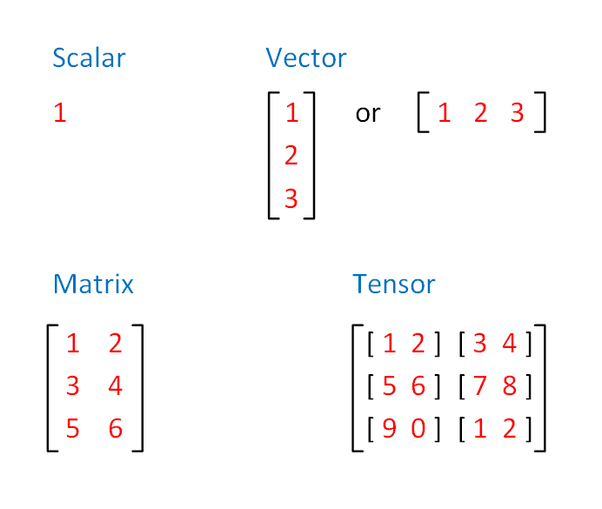

Хэвийн CPU, GPU нь олон талт ажиллагаатай ч, гүн сургалтын загварууд ихэнхдээ:

- Матриц үржвэр

- Өндөр давтамж, бага сааталтай тооцоолол шаардаж байдаг.

- Tensor дээрх тооцоолол

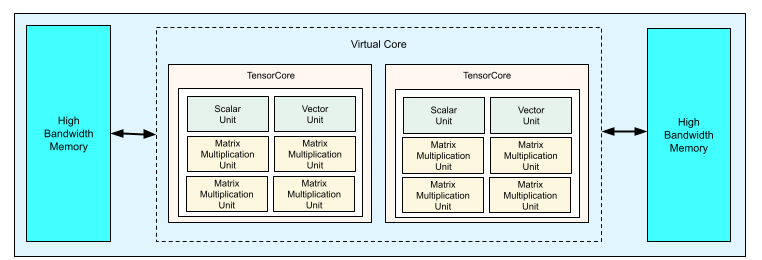

TPU – ийн архитектур

TPU нь нейрон сүлжээний tensor дээрх алгебр үйлдэлд илүү нарийн тохируулагдсан бүтэцтэй бөгөөд үүний архитектурт дараах зүйлс багтана.

- MXU (Matrix multiply units): систолик массивын тусламжтайгаар секундэд олон сая үржвэр – нийлбэрийн тооцоолол хийдэг.

- HBM (High bandwidth memory): асар их хэмжээний өгөгдлийг хурдан уншиж бичихэд зориулагдсан.

- On chip memory: гадаад санах ой руу орох шаардлагыг бууруулдаг

- Vector processing units, scalar матриц биш бусад үйлдлүүдийг хийдэг.

дээр зурагт TPU бүрэлдэхүүн хэсгүүдийг харуулж байна.

TPU – ийн хөгжлийн үе шатууд

| үзүүлэлт | TPUv1 | TPUv2 | TPUv3 | TPUv4 |

| танилцуулагдсан он | 2015 | 2017 | 2018 | 2021 |

| санах ой | 8GiB DDR3 | 1GiB6 HBM | 32GiB HBM | 32GiB HBm |

| ажиллах хурд (clock speed) | 700 MHz | 700 MHz | 940 MHz | 1050 MHz |

| TOPS (TERA operations per second) секундэд 10^12 үйлдэл гүйцэтгэх | 23 | 45 | 123 | 275 |

| чипний литографын хэмжээс | 28nm | 16nm | 16nm | 7nm |

TPU vs GPU vs CPU

| Шинж чанар | CPU | GPU | TPU |

| Ашиглах хүрээ | Ердийн даалгавруудад | Параллель тооцоолол, График дүрслэл, машин сургалтын даалгавар | Машин сургалт, Гүн сургалт |

| Саатал | Бага | Дунд | Маш Бага |

| Эрчим хүчний үр ашигтай байдал | Бага | Дунд | Өндөр |

| Тохируулагдах чадвар | Уян хатан | Хязгаарлагдмал | Зөвхөн машин сургалт, гүн сургалтад тохируулагдсан |

TPU хэрэглэгддэг даалгаврууд

- Эх хэлний боловсруулалт (NLP): BERT, T5, GPT гэх мэт том загварууд дээр

- Компьютерын хараа (Computer vision)

- Хүчитгэсэн сургалт (Reinforcement learning)

- AlphaFold гэх мэт шинжлэх ухааны тооцоололд

TPU дэмждэг python сан

TensorFlow, JAX, PyTorch , Keras 3 гэх сангууд нь одоогоор TPU дэмждэг байгаа бөгөөд мөн Google компанийн хөгжүүлсэн сан дээр суурилсан хэд хэдэн сан байдаг байна.

Нэмж дурдахад

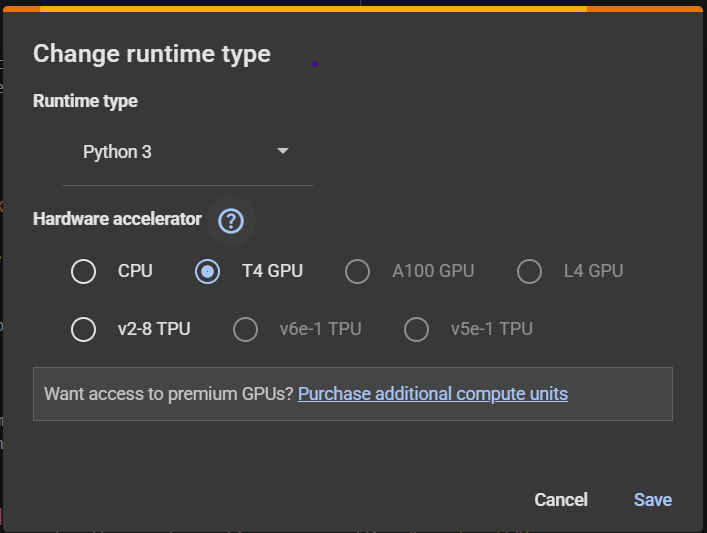

Хэрэв та ямар нэгэн машин сургалт, гүн сургалтын төсөл даалгавар хийж байгаа бидний сайн мэдэх Google Colab – ийн тооцооллын төхөөрөмжүүдэд TPU байдаг байна.

Дээрх зурагт харуулснаар Google colab – ийн үнэгүй эрхэнд Version2 TPU байдаг байна. Энэ нь бидэнд BERT, T5, GPT гэх том загваруудыг ашиглан төсөл даалгавар хийх боломжийг олгож байна.